Considérations relatives à la taille et à l’échelle des Cloud Connectors

Lors de l’évaluation de Citrix DaaS en matière de dimensionnement et d’évolutivité, tenez compte de tous les composants. Recherchez et testez la configuration des Citrix Cloud™ Connectors et de StoreFront pour vos besoins spécifiques. Des ressources insuffisantes pour le dimensionnement et l’évolutivité ont un impact négatif sur les performances de votre déploiement.

Remarque :

- Ces recommandations s’appliquent à Citrix DaaS Standard pour Azure en plus de Citrix DaaS.

- Les tests et recommandations fournis dans cet article sont des lignes directrices pour vous aider à démarrer vos tests. Nous vous recommandons d’effectuer les tests dans votre environnement pour valider le dimensionnement correct du connecteur.

- Pour les considérations de dimensionnement et d’échelle pour le proxy HDX, consultez Considérations relatives à la taille et à l’échelle des Cloud Connectors pour le proxy HDX.

-

Cet article fournit des détails sur les capacités maximales testées et les recommandations de bonnes pratiques pour la configuration des machines Cloud Connector. Les tests ont été effectués sur des déploiements configurés avec StoreFront™ et le cache d’hôte local (LHC).

-

Les informations fournies s’appliquent aux déploiements dans lesquels chaque emplacement de ressources contient à la fois des charges de travail VDI et des charges de travail RDS.

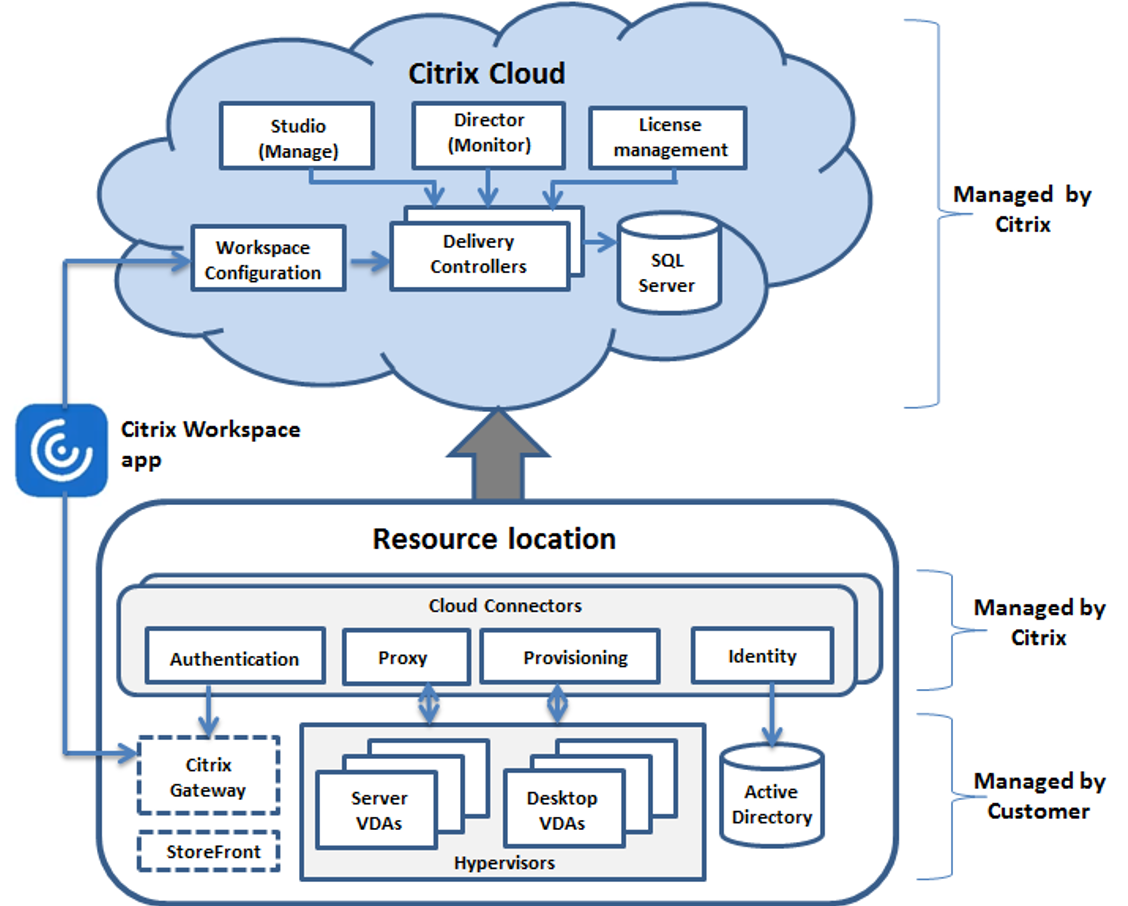

Le Cloud Connector relie vos charges de travail à Citrix DaaS™ des manières suivantes :

- Il fournit un proxy pour la communication entre vos VDA et Citrix DaaS.

- Il fournit un proxy pour la communication entre Citrix DaaS et votre Active Directory (AD) et vos hyperviseurs.

-

Dans les déploiements qui incluent des serveurs StoreFront, le Cloud Connector sert de courtier de session temporaire pendant les pannes cloud, offrant aux utilisateurs un accès continu aux ressources.

- Il est important que vos Cloud Connectors soient correctement dimensionnés et configurés pour répondre à vos besoins spécifiques. Bien que les tests aient été effectués avec deux Cloud Connectors, un seul Cloud Connector est disponible pendant les mises à niveau des Cloud Connectors. Pour garantir une haute disponibilité pendant les mises à niveau des Cloud Connectors, certains clients ont choisi de déployer trois Cloud Connectors.

Chaque ensemble de Cloud Connectors est attribué à un emplacement de ressources (également appelé zone dans Studio). Un emplacement de ressources est une séparation logique qui spécifie quelles ressources communiquent avec cet ensemble de Cloud Connectors. Au moins un emplacement de ressources est requis par domaine pour communiquer avec l’Active Directory (AD).

Chaque catalogue de machines et connexion d’hébergement est attribué à un emplacement de ressources.

Pour les déploiements avec plusieurs emplacements de ressources, attribuez des catalogues de machines et des VDA aux emplacements de ressources afin d’optimiser la capacité du LHC à broker les connexions pendant les pannes. Pour plus d’informations sur la création et la gestion des emplacements de ressources, consultez Se connecter à Citrix Cloud. Pour des performances optimales, configurez vos Cloud Connectors sur des connexions à faible latence aux VDA, aux serveurs AD et aux hyperviseurs.

Processeurs et stockage recommandés

Pour des performances similaires à celles observées lors de ces tests, utilisez des processeurs modernes prenant en charge les extensions SHA. Les extensions SHA réduisent la charge cryptographique sur le CPU. Les processeurs recommandés incluent :

- Processeurs Advanced Micro Devices (AMD) Zen et plus récents

- Processeurs Intel Ice Lake et plus récents

Les processeurs recommandés fonctionnent efficacement. Vous pouvez utiliser des processeurs plus anciens, mais cela pourrait entraîner une charge CPU plus élevée. Nous vous recommandons d’augmenter le nombre de vCPU pour compenser ce comportement.

Les tests décrits dans cet article ont été effectués avec des processeurs AMD EPYC et Intel Cascade Lake.

Les Cloud Connectors ont une lourde charge cryptographique lors de la communication avec le cloud. Les Cloud Connectors utilisant des processeurs avec des extensions SHA subissent une charge plus faible sur leur CPU, ce qui se traduit par une utilisation CPU plus faible par le service de sous-système de l’autorité de sécurité locale (LSASS) de Windows.

Citrix recommande d’utiliser un stockage moderne avec des opérations d’E/S par seconde (IOPS) adéquates, en particulier pour les déploiements qui utilisent le LHC. Les disques SSD (Solid State Drives) sont suggérés, mais les niveaux de stockage cloud premium ne sont pas nécessaires. Des IOPS plus élevées sont nécessaires pour les scénarios LHC où le Cloud Connector exécute une petite copie de la base de données. Cette base de données est régulièrement mise à jour avec les modifications de configuration du site et fournit des capacités de courtage à l’emplacement des ressources en cas de pannes de Citrix Cloud.

Configuration de calcul recommandée pour le cache d’hôte local

Le cache d’hôte local (LHC) assure une haute disponibilité en permettant aux opérations de courtage de connexion dans un déploiement de se poursuivre lorsqu’un Cloud Connector ne peut pas communiquer avec Citrix Cloud.

Les Cloud Connectors exécutent Microsoft SQL Express Server LocalDB, qui est automatiquement installé lorsque vous installez le Cloud Connector. La configuration CPU du Cloud Connector, en particulier le nombre de cœurs disponibles pour SQL Express Server LocalDB, affecte directement les performances du LHC. Le nombre de cœurs CPU disponibles pour SQL Server Express Server LocalDB affecte les performances du LHC encore plus que l’allocation de mémoire. Cette surcharge CPU n’est observée qu’en mode LHC lorsque Citrix DaaS n’est pas joignable et que le broker LHC est actif. Pour tout déploiement utilisant le LHC, Citrix recommande quatre cœurs par socket, avec un minimum de quatre cœurs CPU par Cloud Connector. Pour plus d’informations sur la configuration des ressources de calcul pour SQL Express Server LocalDB, consultez Limites de capacité de calcul par édition de SQL Server.

- Si les ressources de calcul disponibles pour SQL Express Server LocalDB sont mal configurées, les temps de synchronisation de la configuration pourraient être augmentés et les performances pendant les pannes pourraient être réduites. Dans certains environnements virtualisés, la capacité de calcul pourrait dépendre du nombre de processeurs logiques et non des cœurs de CPU.

Résumé des résultats des tests

Tous les résultats de ce résumé sont basés sur les conclusions d’un environnement de test tel que configuré dans les sections détaillées de cet article. Les résultats présentés ici concernent un seul emplacement de ressources. Des configurations système différentes pourraient donner des résultats différents.

- Cette illustration donne un aperçu graphique de la configuration testée.

-

Le tableau suivant présente les configurations minimales recommandées de CPU et de mémoire des Cloud Connectors pour des sites de différentes tailles. Les résultats des tests avec ces configurations sont présentés ci-dessous. Consultez Limites pour plus d’informations sur les limites d’emplacement des ressources.

-

Moyen Grand Maximum - | — | — | — | — |

-

Connecteurs pour la haute disponibilité 2 2 3 -

VDA Jusqu’à 1000 1001 - 5000 5001 - 10,000 -

Sessions Jusqu’à 2500 Jusqu’à 10,000 Jusqu’à 25,000 -

Connexions d’hébergement Jusqu’à 20 Jusqu’à 40 Jusqu’à 40 -

CPU pour les Cloud Connectors 4vCPU 4vCPU 8vCPU -

Mémoire pour les Cloud Connectors 6 Go 8 Go 10 Go

Remarque :

Si votre déploiement dépasse 5000 VDA, vous devez utiliser trois Cloud Connectors pour la haute disponibilité et l’évolutivité.

Méthodologie de test

Des tests ont été effectués pour ajouter de la charge et mesurer les performances des composants de l’environnement. Les composants ont été surveillés en collectant des données de performance et le temps des procédures, telles que le temps de connexion et le temps d’enregistrement. Parfois, des outils de simulation Citrix propriétaires sont utilisés pour simuler des VDA et des sessions. Ces outils sont conçus pour solliciter les composants Citrix de la même manière que les VDA et les sessions traditionnels, sans les mêmes exigences en matière de ressources pour héberger de véritables sessions et VDA. Des tests ont été effectués en mode de courtage cloud et en mode LHC pour les scénarios avec Citrix StoreFront.

Les recommandations concernant le dimensionnement des Cloud Connectors dans cet article sont basées sur les données recueillies lors de ces tests.

Les tests suivants ont été exécutés :

- Tempête de connexion/lancement de session : un test qui simule des périodes de connexion à volume élevé.

- Tempête d’enregistrement VDA : un test qui simule des périodes d’enregistrement VDA à volume élevé. Par exemple, après un cycle de mise à niveau ou une transition entre le courtage cloud et le mode Local Host Cache.

- Tempête d’actions d’alimentation VDA : un test qui simule un volume élevé d’actions d’alimentation VDA.

Scénarios et conditions de test

Ces tests ont été effectués avec LHC configuré. Pour plus d’informations sur l’utilisation de LHC, consultez l’article Local Host Cache. LHC nécessite un serveur StoreFront sur site. Pour des informations détaillées sur StoreFront, consultez la documentation produit StoreFront.

Recommandations pour les configurations StoreFront :

- Si vous avez plusieurs emplacements de ressources avec un seul serveur StoreFront ou groupe de serveurs, activez l’option de vérification de l’état avancée pour le magasin StoreFront. Consultez Exigence StoreFront dans l’article Local Host Cache.

- Pour des taux de lancement de session plus élevés, utilisez un groupe de serveurs StoreFront. Consultez Configurer des groupes de serveurs dans la documentation produit StoreFront.

Conditions de test :

- Les exigences en matière de CPU et de mémoire concernent uniquement le système d’exploitation de base et les services Citrix. Les applications et services tiers pourraient nécessiter des ressources supplémentaires.

- Les VDA sont des machines virtuelles ou physiques exécutant l’agent de livraison virtuel Citrix.

- Les tests sont effectués uniquement à l’aide de VDA Windows.

- Tous les VDA testés étaient gérés par l’alimentation à l’aide de Citrix DaaS.

- Les sessions ont été lancées à un rythme soutenu de 1 000 par minute.

- Des charges de travail de 1 000 à 10 000 VDI et de 500 à 10 000 serveurs RDS avec 1 000 à 25 000 sessions ont été testées.

- Les sessions RDS ont été testées jusqu’à 25 000 par emplacement de ressources.

- Les tests ont été effectués à l’aide de deux Cloud Connectors, à la fois en fonctionnement normal et pendant une panne. Citrix recommande d’utiliser au moins deux Cloud Connectors pour la haute disponibilité, et trois Cloud Connectors pour les emplacements de ressources de taille maximale et grande. En mode panne, un seul des Cloud Connectors est utilisé pour les enregistrements VDA et le courtage. Bien que les tests aient été effectués avec deux Cloud Connectors, un seul Cloud Connector est disponible pendant les mises à niveau. Pour assurer une haute disponibilité pendant les mises à niveau, certains clients ont choisi d’utiliser trois Cloud Connectors.

- Les tests ont été effectués avec le Cloud Connector configuré avec des processeurs Intel Cascade Lake.

- Les sessions ont été lancées via un seul serveur Citrix StoreFront.

-

Les tests de lancement de sessions en cas de panne LHC ont été effectués après le réenregistrement des machines.

-

Le nombre de sessions RDS est une recommandation et non une limite. Testez votre propre limite de sessions RDS dans votre environnement.

-

Remarque :

-

-

-

Le nombre de sessions et le taux de lancement sont plus importants pour RDS que le nombre de VDA.

-

Charges de travail moyennes

- Ces charges de travail ont été testées avec 4 vCPU et 6 Go de mémoire.

-

Charges de travail de test État du site Temps d’enregistrement VDA Utilisation du CPU et de la mémoire lors de l’enregistrement Durée du test de lancement Utilisation du CPU et de la mémoire lors du lancement de session Taux de lancement - | — | — | — | — | — | — | — |

-

1000 VDI En ligne 5 minutes CPU maximum = 36 %, CPU moyen = 33 %, mémoire maximum = 5,3 Go 2 minutes CPU maximum = 29 %, CPU moyen = 27 %, mémoire maximum = 3,7 Go 500 par minute 1000 VDI Panne 4 minutes CPU maximum = 11 %, CPU moyen = 10 %, mémoire maximum = 4,5 Go 2 minutes CPU maximum = 42 %, CPU moyen = 28 %, mémoire maximum = 4,0 Go 500 par minute

-

250 RDS, 5000 sessions En ligne 3 minutes CPU maximum = 14 %, CPU moyen = 4 %, mémoire maximum = 3,5 Go 9 minutes CPU maximum = 46 %, CPU moyen = 21 %, mémoire maximum = 3,7 Go 555 par minute -

250 RDS, 5000 sessions Panne 3 minutes CPU maximum = 15 %, CPU moyen = 5 %, mémoire maximum = 3,7 Go 9 minutes CPU maximum = 51 %, CPU moyen = 32 %, mémoire maximum = 4,2 Go 555 par minute

Charges de travail importantes

Ces charges de travail ont été testées avec 4 vCPU et 8 Go de mémoire.

| Charges de travail de test | État du site | Temps d’enregistrement VDA | Utilisation du CPU et de la mémoire lors de l’enregistrement | Durée du test de lancement | Utilisation du CPU et de la mémoire lors du lancement de session | Taux de lancement |

|---|---|---|---|---|---|---|

| 5000 VDI | En ligne | 3 à 4 minutes | CPU maximum = 45 %, CPU moyen = 25 %, mémoire maximum = 7,0 Go | 5 minutes | CPU maximum = 75 %, CPU moyen = 55 %, mémoire maximum = 7,0 Go | 1000 par minute |

| 5000 VDI | Panne | 4 à 6 minutes | CPU maximum = 15 %, CPU moyen = 5 %, mémoire maximum = 7,5 Go | 5 minutes | CPU maximum = 45 %, CPU moyen = 40 %, mémoire maximum = 7,5 Go | 1000 par minute |

| 500 RDS, 10 000 sessions | En ligne | 3 minutes | CPU maximum = 45 %, CPU moyen = 25 %, mémoire maximum = 7,0 Go | 10 minutes | CPU maximum = 75 %, CPU moyen = 55 %, mémoire maximum = 7,0 Go | 1000 par minute |

| 500 RDS, 10 000 sessions | Panne | 3 minutes | CPU maximum = 15 %, CPU moyen = 5 %, mémoire maximum = 7,5 Go | 10 minutes | CPU maximum = 45 %, CPU moyen = 40 %, mémoire maximum = 7,5 Go | 1000 par minute |

Charges de travail maximales

Ces charges de travail ont été testées avec 8 vCPU et 10 Go de mémoire.

| Charges de travail de test | État du site | Temps d’enregistrement VDA | Utilisation du CPU et de la mémoire lors de l’enregistrement | Durée du test de lancement | Utilisation du CPU et de la mémoire lors du lancement de session | Taux de lancement |

|---|---|---|---|---|---|---|

| 10 000 VDI | En ligne | 3 à 4 minutes | CPU maximum = 85 %, CPU moyen = 10 %, mémoire maximum = 8,5 Go | 7 minutes | CPU maximum = 66 %, CPU moyen = 28 %, mémoire maximum = 7,0 Go | 1400 par minute |

| 10 000 VDI | Panne | 4 à 5 minutes | CPU maximum = 90 %, CPU moyen = 17 %, mémoire maximum = 8,2 Go | 5 minutes | CPU maximum = 90 %, CPU moyen = 45 %, mémoire maximum = 8,5 Go | 2000 par minute |

| 1000 RDS, 20 000 sessions | En ligne | 1 à 2 minutes | CPU maximum = 60 %, CPU moyen = 20 %, mémoire maximum = 8,6 Go | 17 minutes | CPU maximum = 66 %, CPU moyen = 25 %, mémoire maximum = 6,8 Go | 1200 par minute |

| 1000 RDS, 20 000 sessions | Panne | 3 à 4 minutes | CPU maximum = 22 %, CPU moyen = 10 %, mémoire maximum = 8,5 Go | 21 minutes | CPU maximum = 90 %, CPU moyen = 50 %, mémoire maximum = 7,5 Go | 1000 par minute |

Remarque :

Les charges de travail présentées ici sont les charges de travail maximales recommandées pour un seul emplacement de ressources. Pour prendre en charge des charges de travail plus importantes, ajoutez d’autres emplacements de ressources.

Utilisation des ressources de synchronisation de la configuration

Le processus de synchronisation de la configuration maintient les Cloud Connectors à jour avec Citrix DaaS. Les mises à jour sont automatiquement envoyées aux Cloud Connectors pour s’assurer qu’ils sont prêts à prendre le relais en cas de panne. La synchronisation de la configuration met à jour la base de données LHC, SQL Express Server LocalDB. Le processus importe les données dans une base de données temporaire, puis bascule vers cette base de données une fois l’importation terminée. Cela garantit qu’une base de données LHC est toujours prête à prendre le relais.

L’utilisation du CPU, de la mémoire et du disque est temporairement augmentée pendant l’importation des données dans la base de données temporaire.

Conditions de test :

- Testé sur un AMD EPYC à 8 vCPU

- La base de données de configuration du site importée concernait un environnement avec un total de 80 000 VDA et 300 000 utilisateurs (trois équipes de 100 000 utilisateurs) à l’échelle du site

- Le temps d’importation des données a été testé sur un emplacement de ressources avec 10 000 VDI

Résultats des tests :

- Temps d’importation des données : 7 à 10 minutes

-

Utilisation du CPU :

- maximum = 25 %

- moyenne = 15 %

-

Utilisation de la mémoire :

- augmentation d’environ 2 Go à 3 Go

-

Utilisation du disque :

- pic de lecture disque de 4 Mo/s

- pic d’écriture disque de 18 Mo/s

- pic d’écriture disque de 70 Mo/s lors du téléchargement et de l’écriture des fichiers de configuration XML

- pic de lecture disque de 4 Mo/s à la fin de l’importation

-

Taille de la base de données LHC :

- fichier de base de données de 400 à 500 Mo

- base de données de journaux de 200 à 300 Mo

Considérations supplémentaires sur l’utilisation des ressources :

- Pendant l’importation, l’ensemble des données de configuration du site est téléchargé. Ce téléchargement peut provoquer un pic de mémoire, en fonction de la taille du site. Si des pics de mémoire se produisent pendant les synchronisations de configuration, envisagez d’augmenter la taille des Cloud Connectors.

- Le site testé utilisait environ 800 Mo pour les fichiers de base de données et de journaux combinés. Lors d’une synchronisation de configuration, ces fichiers sont dupliqués avec une taille combinée maximale d’environ 1600 Mo. Assurez-vous que votre Cloud Connector dispose de suffisamment d’espace disque pour les fichiers dupliqués. Le processus de synchronisation de la configuration échoue si le disque est plein.