-

Bereitstellung planen und aufbauen

-

-

WebSocket-Kommunikation zwischen VDA und Delivery Controller™

-

Verbindungen erstellen und verwalten

-

-

Identitätspools verschiedener Maschinenidentitäts-Join-Typen

-

Identitätspool für in lokale Active Directory eingebundene Maschinenidentität

-

Identitätspool für in Microsoft Entra eingebundene Maschinenidentität

-

Identitätspool für hybrid in Microsoft Entra eingebundene Maschinenidentität

-

Identitätspool für Microsoft Intune-fähige Maschinenidentität

-

Identitätspool für nicht in Domäne eingebundene Maschinenidentität

-

-

Eigenständiger Citrix Secure Ticketing Authority (STA)-Dienst

-

Workloads zwischen Ressourcenstandorten mit dem Image Portability Service migrieren

-

-

Multimedia

-

This content has been machine translated dynamically.

Dieser Inhalt ist eine maschinelle Übersetzung, die dynamisch erstellt wurde. (Haftungsausschluss)

Cet article a été traduit automatiquement de manière dynamique. (Clause de non responsabilité)

Este artículo lo ha traducido una máquina de forma dinámica. (Aviso legal)

此内容已经过机器动态翻译。 放弃

このコンテンツは動的に機械翻訳されています。免責事項

이 콘텐츠는 동적으로 기계 번역되었습니다. 책임 부인

Este texto foi traduzido automaticamente. (Aviso legal)

Questo contenuto è stato tradotto dinamicamente con traduzione automatica.(Esclusione di responsabilità))

This article has been machine translated.

Dieser Artikel wurde maschinell übersetzt. (Haftungsausschluss)

Ce article a été traduit automatiquement. (Clause de non responsabilité)

Este artículo ha sido traducido automáticamente. (Aviso legal)

この記事は機械翻訳されています.免責事項

이 기사는 기계 번역되었습니다.책임 부인

Este artigo foi traduzido automaticamente.(Aviso legal)

这篇文章已经过机器翻译.放弃

Questo articolo è stato tradotto automaticamente.(Esclusione di responsabilità))

Translation failed!

Multimedia

-

Der HDX™-Technologie-Stack unterstützt die Bereitstellung von Multimedia-Anwendungen durch zwei komplementäre Ansätze:

- Multimedia-Bereitstellung mit serverseitigem Rendering

-

Multimedia-Umleitung mit clientseitigem Rendering

-

Diese Strategie stellt sicher, dass Sie eine vollständige Palette von Multimedia-Formaten mit einer hervorragenden Benutzererfahrung bereitstellen können, während gleichzeitig die Serverskalierbarkeit maximiert wird, um die Kosten pro Benutzer zu senken.

- Bei der serverseitigen Multimedia-Bereitstellung werden Audio- und Videoinhalte von der Anwendung auf dem Citrix DaaS-Server (ehemals Citrix Virtual Apps and Desktops Service) dekodiert und gerendert. Die Inhalte werden dann komprimiert und über das ICA-Protokoll an die Citrix Workspace-App auf dem Benutzergerät übermittelt. Diese Methode bietet die höchste Kompatibilität mit verschiedenen Anwendungen und Medienformaten. Da die Videoverarbeitung rechenintensiv ist, profitiert die serverseitige Multimedia-Bereitstellung erheblich von der integrierten Hardwarebeschleunigung. Zum Beispiel entlastet die Unterstützung für DirectX Video Acceleration (DXVA) die CPU, indem sie die H.264-Dekodierung in separater Hardware durchführt. Intel Quick Sync-, AMD RapidFire- und NVIDIA NVENC-Technologien bieten hardwarebeschleunigte H.264-Kodierung.

Da die meisten Server keine Hardwarebeschleunigung für die Videokomprimierung bieten, wird die Serverskalierbarkeit negativ beeinflusst, wenn die gesamte Videoverarbeitung auf der Server-CPU erfolgt. Sie können eine hohe Serverskalierbarkeit aufrechterhalten, indem Sie viele Multimedia-Formate zur lokalen Wiedergabe an das Benutzergerät umleiten.

- Die Windows Media-Umleitung entlastet den Server für eine Vielzahl von Medienformaten, die typischerweise mit dem Windows Media Player verbunden sind.

- HTML5-Video ist populär geworden, und Citrix® hat eine Umleitungstechnologie für diese Art von Inhalten eingeführt. Wir empfehlen die Browserinhaltsumleitung für Websites, die HTML5, HLS, DASH oder WebRTC verwenden.

- Sie können die allgemeinen Umleitungstechnologien Host-zu-Client-Umleitung und Lokaler App-Zugriff auf Multimedia-Inhalte anwenden.

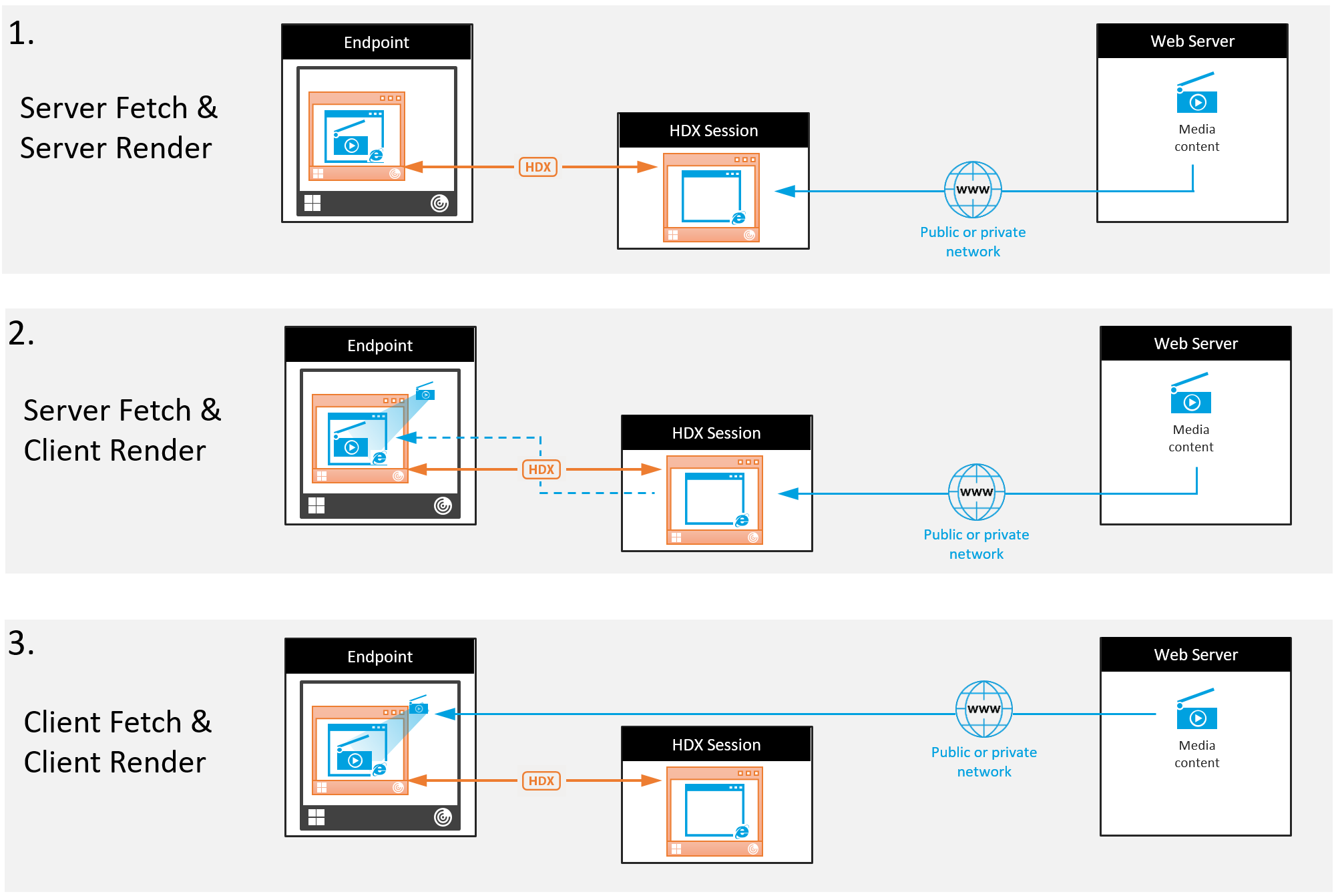

Zusammenfassend lässt sich sagen: Wenn Sie keine Umleitung konfigurieren, führt HDX ein serverseitiges Rendering durch. Wenn Sie eine Umleitung konfigurieren, verwendet HDX entweder Server Fetch und Client Render oder Client Fetch und Client Render. Wenn diese Methoden fehlschlagen, greift HDX bei Bedarf auf serverseitiges Rendering zurück und unterliegt der Richtlinie zur Verhinderung von Rückfällen.

Beispielszenarien

Szenario 1. (Server-Abruf und Server-Rendering):

- Der Server ruft die Mediendatei von ihrer Quelle ab, dekodiert sie und präsentiert den Inhalt dann einem Audiogerät oder Anzeigegerät.

- Der Server extrahiert das präsentierte Bild oder den Ton vom Anzeigegerät bzw. Audiogerät.

- Der Server komprimiert es optional und überträgt es dann an den Client.

Dieser Ansatz verursacht hohe CPU-Kosten, hohe Bandbreitenkosten (wenn das extrahierte Bild/der Ton nicht effizient komprimiert wird) und hat eine geringe Serverskalierbarkeit.

Thinwire- und Audio-Virtual Channels handhaben diesen Ansatz. Der Vorteil dieses Ansatzes ist, dass er die Hardware- und Softwareanforderungen für die Clients reduziert. Bei diesem Ansatz erfolgt die Dekodierung auf dem Server, und er funktioniert für eine größere Vielfalt von Geräten und Formaten.

Szenario 2. (Server-Abruf und Client-Rendering):

Dieser Ansatz basiert auf der Möglichkeit, Medieninhalte abzufangen, bevor sie dekodiert und dem Audio- oder Anzeigegerät präsentiert werden. Der komprimierte Audio-/Videoinhalt wird stattdessen an den Client gesendet, wo er dann dekodiert und lokal präsentiert wird. Der Vorteil dieses Ansatzes ist, dass die Last auf die Clientgeräte ausgelagert wird, wodurch CPU-Zyklen auf dem Server eingespart werden.

Er führt jedoch auch zu zusätzlichen Hardware- und Softwareanforderungen für den Client. Der Client muss in der Lage sein, jedes Format zu dekodieren, das er möglicherweise empfängt.

Szenario 3. (Client-Abruf und Client-Rendering):

Dieser Ansatz basiert auf der Möglichkeit, die URL des Medieninhalts abzufangen, bevor sie von der Quelle abgerufen wird. Die URL wird an den Client gesendet, wo der Medieninhalt abgerufen, dekodiert und lokal präsentiert wird. Dieser Ansatz ist konzeptionell einfach. Sein Vorteil ist, dass er sowohl CPU-Zyklen auf dem Server als auch Bandbreite spart, da der Server nur Steuerbefehle sendet. Die Medieninhalte sind jedoch nicht immer für die Clients zugänglich.

Framework und Plattform:

Einzelsitzungs-Betriebssysteme (Windows, Mac OS X und Linux) bieten Multimedia-Frameworks, die die schnellere Entwicklung von Multimedia-Anwendungen ermöglichen. Diese Tabelle listet einige der populärsten Multimedia-Frameworks auf. Jedes Framework unterteilt die Medienverarbeitung in mehrere Stufen und verwendet eine Pipeline-basierte Architektur.

| Framework | Plattform |

|---|---|

| DirectShow | Windows (98 und höher) |

| Media Foundation | Windows (Vista und höher) |

| Gstreamer | Linux |

| Quicktime | Mac OS X |

Double-Hop-Unterstützung mit Medienumleitungstechnologien

| Audio-Umleitung | Nein | |

| Browserinhaltsumleitung | Nein | |

| HDX Webcam-Umleitung | Ja | |

| HTML5 Video-Umleitung | Ja | |

| Windows Media-Umleitung | Ja | |

Teilen

Teilen

In diesem Artikel

This Preview product documentation is Citrix Confidential.

You agree to hold this documentation confidential pursuant to the terms of your Citrix Beta/Tech Preview Agreement.

The development, release and timing of any features or functionality described in the Preview documentation remains at our sole discretion and are subject to change without notice or consultation.

The documentation is for informational purposes only and is not a commitment, promise or legal obligation to deliver any material, code or functionality and should not be relied upon in making Citrix product purchase decisions.

If you do not agree, select I DO NOT AGREE to exit.